2025.08.21 「AIが起こす事故」発生時の民事責任 経産省が有識者研究会を始動

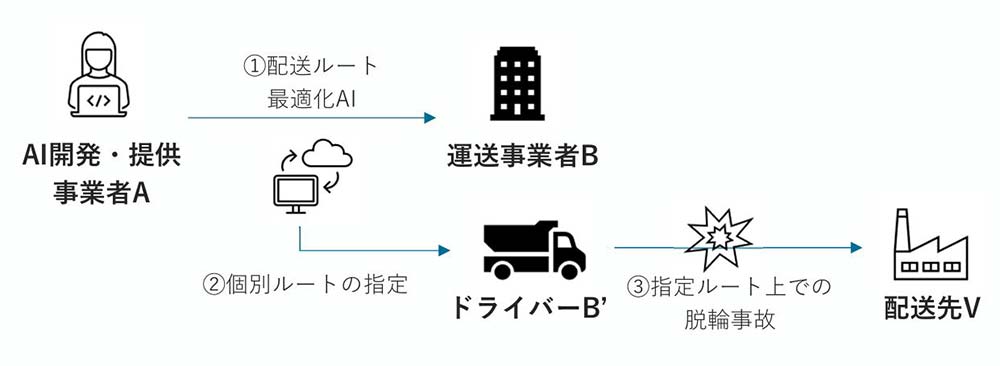

AIを用いた運送業務で想定される事故 出所:経済産業省「AI利活用における民事責任の在り方に関する研究会」

経済産業省は、人工知能(AI)が引き起こす事故の発生時に民事責任が問われることを想定し、責任のあり方について議論する有識者研究会を立ち上げた。今年度中をめどに成果を取りまとめる予定。被害者や企業担当者、裁判官などの関係者が参考にできる方向性を示し、迅速な事故処理や被害回復につなげることを目指す。

新たに設けたのは「AI利活用における民事責任の在り方に関する研究会」で、19日に初会合を開いた。座長には早稲田大学法学学術院の大塚直教授が就任。構成員には、京都大学大学院法学研究科教授やSTORIA法律事務所の代表パートナー弁護士らも名を連ねた。オブザーバーとして内閣府科学技術・イノベーション推進事務局や法務省民事局などの関係府省庁のほか、政府機関のAIセーフティ・インスティテュート(AISI)や日本損害保険協会、日本弁護士連合会も参加した。

進化著しいAIは、便利な手段として日常生活やビジネスシーンに浸透する一方、第三者の財産的権利を侵害したり、アクチュエーター(駆動装置)を通じて物理的な事故を引き起こしたりするリスクが無視できなくなっている。こうした動きを踏まえて研究会では、AIの利活用に伴う事故に対して誰が民事上の責任を負うかといったテーマに着目。「不法⾏為法」や「製造物責任法」の観点から議論を深め、論点や考え方を整理する。

仮想事例を題材に検討

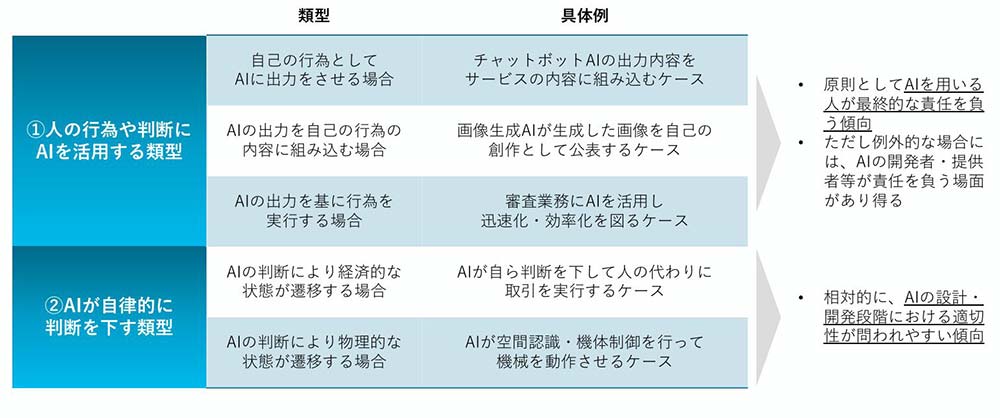

研究会では、代表的な事例を想定し、⼀定の汎⽤的な考え⽅や判断の枠組みを抽出したい考えだ。想定事例は、⼈の⾏為や判断にAIを活⽤するケースと、AIが⾃律的に判断を下すケースに分類。前者の場合、原則としてAIを⽤いる⼈が最終的な責任を負う傾向にあるという。

例えば、運送会社が配送ルートを最適化するAIシステムを使うケースが想定される。ある⽇、幅員が狭く⼤型⾞両の運⾏に適さない悪路を「最適ルート」と表⽰。運送業務を担うドライバーは当該道路への進⼊に躊躇したが、AIの出⼒に従った結果、運⾏のための⼗分なスペースがなく脱輪。これが⼤幅な遅配につながるとともに、その際の衝撃で配送先への荷物が損壊した。

これは、会社とドライバーが負う注意義務が論点となるケースだ。AIシステムはあくまで「運⾏上の判断の補助ツール」という位置付けで、ドライバーは安全な⾛⾏経路を選ぶ義務を負うと考えられる。会社側がドライバーに対してAIの判断に必ず従うよう義務づけていた場合、体制構築上の注意義務が論点となり得る。 システムを提供する事業者が、配送先に対し何らかの注意義務を負うかも焦点になるという。

政府はAI関連技術の進展を踏まえ、昨年4月にAIの事業活動を担う主体が取り組む事項を整理した「AI事業者ガイドライン」を策定。この指針を通じて、AIがもたらす社会的なリスクを考慮しながらイノベーション(技術革新)を促してきた。一方、事故発生時の民事責任のあり方については 裁判例や統一的な見解がなく、責任の所在が不明瞭であることがシステムの導入や開発を躊躇させる一因となっている。 そこで経産省は、研究会を通じて民事責任を巡る議論を進めることにした。同ガイドラインと民事責任の関係性にも着目していく。

経産省としては、事故発生時の責任論について予測可能性を高めるとともに、今回の議論をビジネスしやすい環境づくりにつなげたい考えだ。「新規技術の開発や導入を促して産業を活性化したい」としている。