2024.12.20 AIサーバー向けだけじゃない!エヌビディアが低価格の小型スーパーコンピューター

Jetson Orin Nano Super

生成AI(人工知能)の普及拡大が進むとともに、膨大なデータを処理するデータセンター(DC)の建設ラッシュが世界各地で進んでいる。DCの中には高性能のAIサーバーや大容量ストレージが格納され、膨大なデータを処理している。これらのデータセンターの中にはスーパーコンピューター並みの演算処理性能を備えたものもある。しかし、今後AIが普及していく中で、全てのデータをクラウド(DC)で処理することは難しい。リアルタイム性が求められる自動運転などのデータ処理においては、クラウド側にデータを送り、処理をしている間に遅延が発生してしまう。そのため、さまざまな機器にAIが搭載され、機器内部でAI処理を行うことが求められる。これが「エッジAI」と呼ばれるものだ。

エヌビディアは、AIサーバーに搭載されるGPUを供給し、AIを支える半導体メーカーとして知られる。しかし、このようなAIサーバーをはじめとするHPC(High Performance Computing)向けだけでなく、エッジ向けの組み込みボードなども数多く手掛けている。同社は18日、優れた性能を低価格で提供する新しい小型の生成AIスーパーコンピューター「Jetson Orin Nano Super」を発表した。同製品の開発者キットは、手のひらに収まるサイズで、商用AIの開発者からホビイスト、学生まで幅広く、生成AIの機能と性能を使ってアプリケーションを試作することができる。キットの価格は249ドル(約3万9000円)。

幅広い用途に対応

エヌビディアのロボット工学・エッジコンピューティング担当副社長兼ゼネラルマネージャーであるディープ・タラ氏は、オンライン・メディア・ブリーフィングで「JetsonおよびIsaacプラットフォームは、AIを搭載した自律型マシンやエッジコンピューティング・アプリケーションを開発するために必要な機能を一貫したソリューションとして提供する」と述べた。

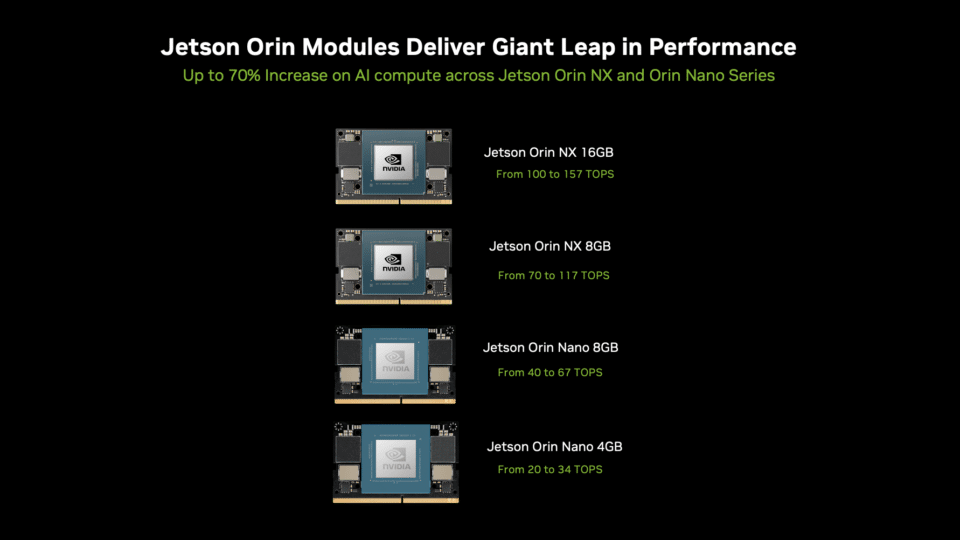

生成AI推論のパフォーマンスが1.7倍に向上。性能は70%向上し67 INT8 TOPSになったほか、前モデルと比較してメモリ帯域幅が50%向上し、102ギガバイト秒になった。さらに、Jetson Orin Nano Superは、検索拡張機能(RAG)に基づくLLMチャットボットの作成、ビジュアルAIエージェントの構築、AIベースのロボットの展開など、さまざまな用途に合う理想的なソリューションを実現できる。

さらに、タラ氏は、新しいJetson Orin Nano Superで利用可能なソフトウェア・アップデートは、従来の『Jetson Orin Nano開発者キット』を所有している人にとっても、生成AIのパフォーマンス向上につながる」と述べている。

生成AIのための強力なパフォーマンス

Jetson Orin Nano Superの強化された性能は、全ての一般的な生成AIモデルとトランスフォーマベースのコンピュータビジョンに利点をもたらす。さらに、開発者キットはJetson Orin Nano 8GBシステム・オン・モジュール(SoM)とリファレンス・キャリアー・ボードで構成され、エッジAIアプリケーションのプロトタイピングに理想的なプラットフォームを提供する。SoMはTensorコア搭載のNVIDIA AmpereアーキテクチャGPUと6基のArm CPUを搭載し、複数かつ並列的なAIアプリケーションパイプラインと高性能推論を可能にする。最大4台のカメラをサポートし、従来モデルよりも高い解像度とフレームレートを提供する。

生成AIは急速に進化している。同社はオープンソースコミュニティーや最先端モデルに対応し、開発者を支援する体制を整えている。HPC向けのみならず、エッジ向けのAIソリューションも視野に入れ、全方位的にAIの普及拡大を後押しする。