2024.01.18 【情報通信総合特集】2024市場/技術トレンド 生成AI

幅広い業種を変革 ICT各社の存在感も高まる

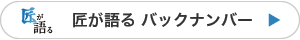

世界需要、30年に20倍の2110億ドル

リテラシー、スキル不足に懸念

2024年は、人間のように多彩なコンテンツを作り出す「生成AI(人工知能)」の応用範囲が広がる年となる。生成AIを含めた先端的な有望技術の市場を巡っては、グローバルな覇権争いが激化する方向にある。生成AIはIT以外の幅広い業種にも変革をもたらす可能性を秘めているだけに、開発や活用の遅れは日本経済の競争力低下に直結しかねない。生成AIの社会実装を後押しするICT関連各社の役割も増しそうだ。

■彗星のように登場

「本年は、彗星(すいせい)のように現れた革新技術である生成AIの利活用がさらに進むだろう。生成AIは埋もれていた情報に確実に光を当てることで、私たちの知的作業を強力にサポートしてくれる」(日立製作所の小島啓二社長兼CEO)、「生成AIの出現は現場よりも経営者に大きな影響があったと言える。もはや生成AIの話をしない経営者はいない」(東芝の島田太郎社長執行役員CEO)。

社会インフラを支える総合電機大手のトップは年頭所感で生成AIに触れ、AIで社会や経済の変革を促す決意を表明した。

IT事業を主力とするNECの森田隆之社長兼CEOも「私たちの技術の系譜に生成AIが加わった。これはインターネットの登場以来の革新といわれ、世界中で一気に普及し進化を続けている」と強調した。

既に各社は、イノベーション(技術革新)を生み出す力を生成AIで高めようと、体制づくりを加速させている。

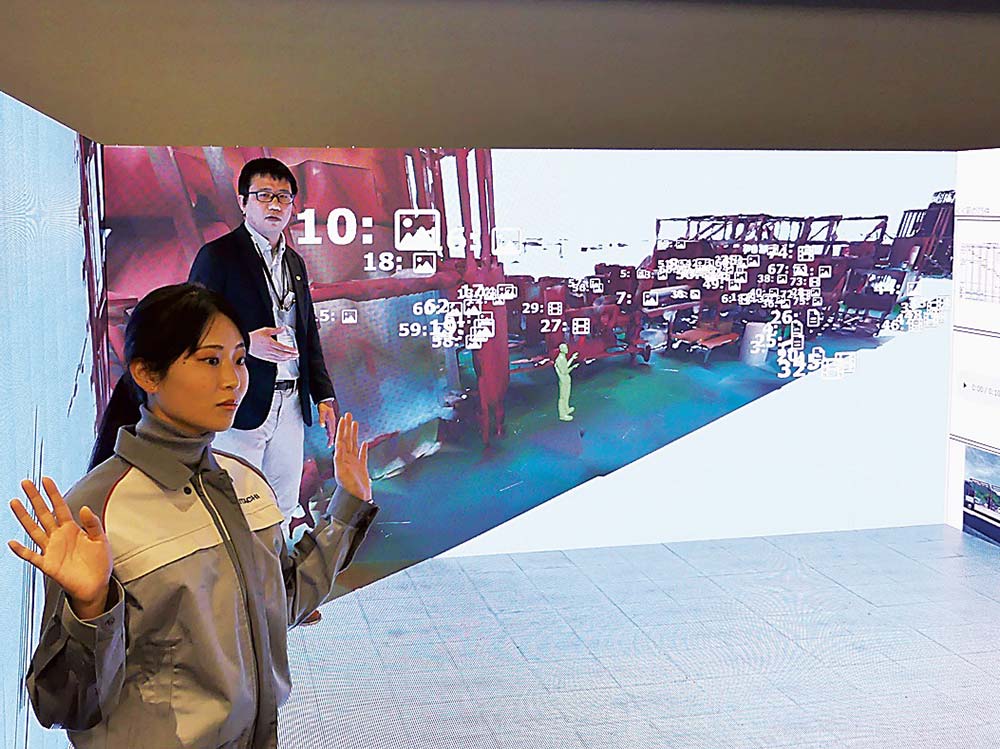

日立は、生成AIの有効活用を社内外で促そうと、昨年5月に新組織「Generative AIセンター」を設立。昨年12月には、現場データの収集技術や生成AIを駆使する「現場拡張メタバース」を開発したと発表した。例えば、インターネット上の仮想空間「メタバース」に原子力発電所の構造物を再現し、所内の現場作業を効率化。作業の状況を確かめたい作業員が生成AIに質問を投げかけると、データを抽出して回答してくれる。

NECは昨年12月、生成AIの基盤を担う独自開発のLLM(大規模言語モデル)「cotomi(コトミ)」を拡充し、デジタルトランスフォーメーション(DX)を支援する共通基盤「NEC Digital Platform」として展開を始めると発表した。24年春から培った各業種・業務のノウハウを生かした「特化モデル」を整備し、医療や金融などの幅広い業種の変革を支援したい考えだ。

■世界需要額が20倍

各社の視線の先には、成長が見込まれる生成AI市場がある。電子情報技術産業協会(JEITA)が公表した「生成AI市場の世界需要額見通し」によると、23年に106億ドル(約1兆5000億円)に達した世界の需要額は、30年には約20倍の2110億ドルにまで成長する見込みだ。

日本市場は30年に、現在の15倍となる1兆7774億円に増えると予測する。アプリケーションが急速に普及するとともに、専門分野向け生成AIの活用ニーズも拡大し、徐々に応用範囲が広がるとの見方を示す。

生成AIの利活用を分野別に見ると、特に伸長が著しいのが製造分野で、活用事例は製造現場の業務支援や製品開発支援などと多岐にわたる。年平均54.6%で成長し、30年には507億ドルへ拡大する見通し。そのほか金融や公共、通信・放送などの分野でも、作業の効率化や創作活動の拡大などに向けた利活用が活発化すると予測している。

ただ、生成AIの有効活用を促す過程で、多くの課題が立ちはだかる。野村総合研究所が国内大手企業459社のCIO(最高情報責任者)やIT担当役員らを対象に23年9月に実施した「IT活用実態調査」の結果で、リテラシーやスキルが不足している傾向などが浮かび上がった。

調査結果によると、IT投資が引き続き増加傾向にある中、生成AIの導入率は24.2%となり、「検討」まで含めると約8割となった。一方で生成AIの活用に関わる課題に目を向けると「リテラシーやスキルが不足している」との回答が64.6%で最も多く、これに「リスク(セキュリティー、コンプライアンスなど)を把握し管理することが難しい」「AIを使ったサービス開発・運用のノウハウがない」などが続いた。

そうした回答の背景には、AIシステムに意図しない動作をさせる新たな攻撃手法「プロンプト・インジェクション」や偽情報の出力といった多様なリスクが潜在する。生成AIの適用範囲を社内のオフィスワークにとどまらず多彩な業務領域に広げる過程で、リスクへの対処も重要な課題として突き付けられている。

政府、AI事業者向け指針を策定

■政府も環境づくり

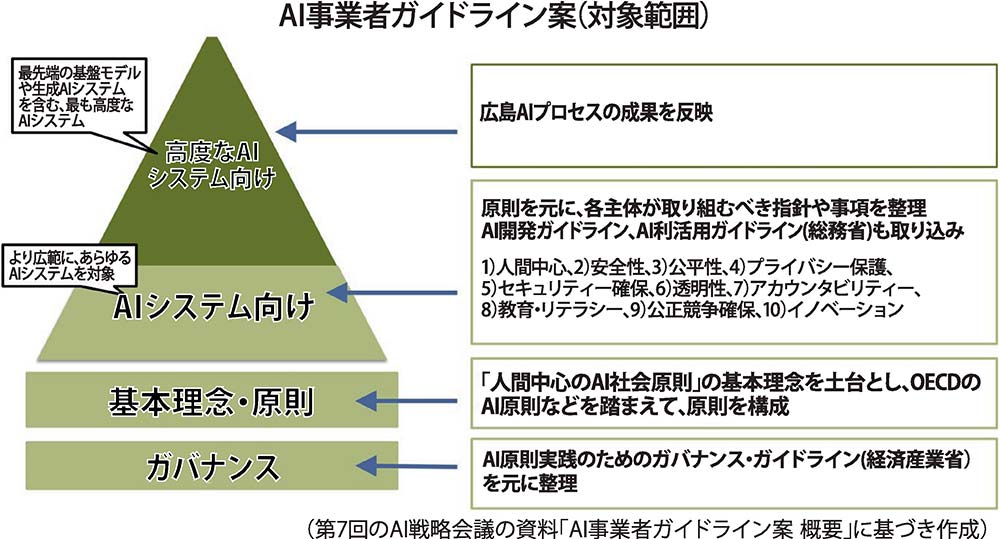

AIの適切な活用を促す政府の動きも加速している。昨年12月には、AIに関する政策の方向性について話し合う有識者会議「AI戦略会議」の第7回会合を開き、AIの安全・安心な利用を促す国内事業者向けガイドライン(指針)案を示した。意見公募を経て、3月までに策定・公表する予定。

指針案では、政府が示した「人間中心のAI社会原則」という基本理念や原則を土台にしながら、AIを開発・提供・利用する全ての関係者が留意すべき事項を整理した。

具体的には「人間中心」「安全性」「公平性」「プライバシー保護」「セキュリティー確保」「透明性」「アカウンタビリティー(説明責任)」「教育・リテラシー」「公正競争確保」「イノベーション」という10項目を明記した。

中でもAIシステムを開発する事業者に対しては、学習データを適切に収集して適正利用につながる開発に取り組むよう要求。セキュリティー対策の仕組みを導入するとともに、開発後も最新動向に留意してリスクに対応することも求めた。

AIサービスの提供者には、AI開発者が設定した範囲内で生かすよう要求。AI利用者にも適正利用を促し、バイアス(偏り)に留意し責任を持って出力結果の利用を判断することなどを求めた。

会合で岸田文雄首相は、英国や米国でAIの安全性研究を行う機関が創設された動きに言及。日本としてもAIの安全性評価手法の研究などを行う機関を今月中にも設立する方針を表明した。「AIの技術やビジネスは今後も変化し続ける。今後起こり得ることを予測しながら、規制と利用促進を一体的に進める方策を引き続き議論してほしい」とも述べた。

国際的なAIルールを協議する枠組み「広島AIプロセス」を巡っては、昨年12月上旬に主要7カ国(G7)首脳が閣僚級会合の成果を承認した。指針案には、高度なAIシステムに関する国際指針と、それを具体的に示す行動規範をまとめた広島AIプロセスの内容も反映させている。

AIや量子技術に象徴される先端技術は国の安全保障の土台で、そうした技術を他国に依存すると、非常時に使えず国民生活を揺るがしかねない。それだけに経済安全保障にも直結する技術を扱うICT関連業界が果たす役割は大きい。各社は強みを発揮し、熾烈(しれつ)な競争が繰り広げられる先端技術の関連市場で競争優位に立てるか。真価が問われるのはこれからだ。